¿Se debe permitir y adoptar la IA con las lecciones de la nube pública?

La capacidad de operacionalizar datos mejor que los competidores ha demostrado ser una ventaja ganadora para las empresas, por lo que se deduce que lo que parecen discusiones incesantes sobre ChatGPT y la IA generativa se están convirtiendo rápidamente en una ola de lanzamientos de productos "listos para disparar, apuntar" y nuevas empresas que reciben financiación. Estas capacidades suponen avances de muchos órdenes de magnitud si funcionan y escalan de forma segura, precisa, con objetividad, etc. Parece que estamos en los inicios de la nube pública, tanto en términos de publicidad como de ventajas técnicas, pero esta vez será más difícil porque el salto es mucho mayor.

Amazon Web Services (AWS) lanzó SQS en 2004, seguido de S3 y EC2 en 2006. Si aceptamos estos como el inicio de la cronología de la nube pública, o cuando comenzó a usarse ampliamente, entonces eso significa que las empresas que aún no han adoptado la nube pública han aceptado dos décadas de costo de oportunidad . La nube pública probablemente era demasiado riesgosa para las empresas reguladas en 2006, pero ¿qué pasará en 2016 o 2026? Hemos visto a instituciones financieras, gobiernos y otras organizaciones tradicionalmente adversas al riesgo adoptar la nube pública para algunas o todas sus aplicações y datos. Los beneficios, por ejemplo para aquellos que aprenden a operacionalizar sus datos y cómo escalar la tecnología subyacente simultáneamente, han sido tan grandes que cualquiera que no haya comenzado su adopción puede llegar demasiado tarde para cerrar la ventaja que ha cedido.

A diferencia de la nube pública, las empresas no tendrán décadas para evaluar y adoptar capacidades como la IA si desean seguir siendo competitivas, una preocupación para las empresas ya que la línea de tiempo de la IA no comienza con ChatGPT. El espacio se mueve demasiado rápido y las capacidades parecen ser muchos órdenes de magnitud más avanzadas que lo que probablemente estará disponible a partir de tecnologías alternativas en el corto plazo. La IA conversacional con interfaces de usuario familiares como ChatGPT ha permitido una adopción más rápida por parte de un grupo más diverso de personas sin requerir conocimientos especializados como lo hizo y sigue haciendo la nube pública. Los nuevos usuarios lo consideran innovador, mientras que los que están más familiarizados con este campo señalan otros avances y se preguntan por qué de repente tanta gente presta atención.

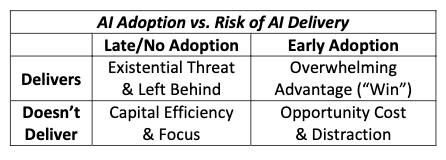

Aquellos que adopten la tecnología antes que sus competidores tendrán una ventaja abrumadora si la tecnología da resultados y se les concederá indulgencia cuando (no si) cometan un error al principio de su curva de adopción. “El espacio está en las primeras etapas de su evolución y todos estamos aprendiendo, pero aquí en <ACME> seguimos siendo líderes en este emocionante y competitivo…” La IA generativa probablemente escribirá el comunicado de prensa y los mercados olvidarán rápidamente el cráter humeante mientras recompensan la siguiente iteración como los numerosos titulares sobre seguridad del consumidor y violación de datos a los que nos hemos acostumbrado.

Al igual que con la nube pública, su adopción se producirá independientemente de las preocupaciones legales, de TI, de seguridad y de cumplimiento. Para los pioneros, la adopción será directa, incorporando IA en sus procesos y productos. Esto impulsará la adopción indirecta por parte de las empresas que prefieren “esperar y ver” ya que utilizarán software o SaaS que tiene IA incorporada, lo sepan o no, lo que significa que sus datos ingresarán a estos sistemas si aún no lo han hecho. Algunos de ellos serán obvios, como las empresas de tecnología que aceptan rápidamente los riesgos y evalúan las consecuencias después de la implementación, pero el riesgo más difícil de gestionar para los programas de seguridad serán las aplicações de IA por debajo de la línea de flotación, como las que ya hemos visto en finanzas y seguros. Seguimos viendo evidencia en el análisis de infracciones de que la gestión de riesgos de terceros no puede inventariar adecuadamente el uso de datos posteriores y los proveedores de servicios secundarios por debajo de la línea de flotación, especialmente para clasificaciones de datos menos reguladas que no entran en el alcance de normas como GDPR e HIPAA y otras, por lo que es probable que los programas de seguridad tampoco conozcan o comprendan el uso de IA en su cadena de suministro de proveedores.

Dada la atención que ChatGPT ha generado con su facilidad de uso y rendimiento, la probabilidad de que un empleado haya enviado información confidencial o de propiedad exclusiva de su empresa a ChatGPT se acerca al 100%. Felicitaciones, su empresa ha adoptado IA generativa incluso si les pidió a sus empleados que no lo hicieran . Esta sensación debería ser familiar porque probablemente es lo que usted sintió cuando descubrió que alguien en ingeniería pasó su tarjeta de crédito para implementar la nueva aplicação de su equipo en la nube pública solo para ser recompensado por la empresa por su tiempo de comercialización más rápido, su enfoque innovador y la adopción de tecnología de vanguardia. En la mayoría de los entornos actuales, pedirle a un equipo de tecnología que no use la nube pública es como pedirle a un empleado que no use la búsqueda de Google en su trabajo diario.

Aquí es donde la seguridad debe adelantarse a la adopción y guiarla por un camino apropiado al riesgo, usando su experiencia en la materia para ayudar a sus pares a desarrollar una tesis de inversión, un modelo de madurez y una hoja de ruta apropiados al riesgo antes de que terceros y los reguladores intenten prescribir su propio enfoque. Antes de adentrarnos en las profundidades del Marco de Gestión de Riesgos de Inteligencia Artificial (AI RMF 1.0) del NIST y realizar un análisis de brechas en sus prácticas actuales, estos son algunos ejemplos de conversaciones iniciales que los equipos de seguridad deberían explorar internamente y con sus pares:

- ¿Cómo determinamos qué parte del valor prometido se cumple, es aspiracional o improbable? ¿Qué propiedades necesitaríamos ver antes de invertir en un experimento frente al desarrollo de un producto o algún nivel de inversión mayor?

- ¿Cuál es la probabilidad de que nuestros competidores adopten una estrategia antes que nosotros? Si tienen éxito, ¿será la adopción subsiguiente la única manera de cerrar la brecha o habrán obtenido una ventaja insuperable?

- ¿Esta decisión es una puerta de un solo sentido o de doble sentido? ¿Existen riesgos conocidos asociados con la adopción? ¿Cuál es el impacto material si adoptamos medidas y encontramos riesgos nuevos?

- ¿Hasta qué punto podemos poseer esta tecnología internamente y mantener un control positivo sobre nuestros datos y sistemas? ¿Tenemos o podemos razonablemente obtener el talento necesario? ¿Es más seguro confiar en un proveedor de servicios externo para esta tecnología?

Ninguna de estas preguntas menciona ChatGPT ni la IA. Generalmente, son temas de conversación razonables para que cualquier programa de seguridad basada en riesgos evalúe las tecnologías iniciales antes de su adopción, ya sea BYOD (traiga su propio dispositivo), la nube pública, los contenedores, el aprendizaje automático o, eventualmente, la IA. Este no fue el enfoque que muchos equipos adoptaron con la nube pública, y se quedaron desprevenidos e inconscientes al darse cuenta de su uso directo e indirecto en sus organizaciones. Los actores de amenazas no tardaron en adaptarse y aprendieron y explotaron las propiedades de la nube pública más rápido que la mayoría de los consumidores: toda tecnología es de doble uso.

Es difícil o imposible predecir la dirección y la adopción de tecnología, pero es predecible que seguirá acelerándose . Si la iteración actual o una iteración cercana de la IA choca contra un muro y deja de avanzar, o la IA demuestra no ser viable en escalas técnicas mayores o por razones de costo, ya habrá alcanzado un estado utilizable y en el que las empresas puedan invertir. Si la IA no se topa con un muro, probablemente se convertirá en una inversión esperada y un medio para interactuar con datos, productos y empresas, tal como ya hemos visto que sucede en ventas, marketing, atención médica y finanzas. Por lo tanto, es una realidad actual, no futura, que los equipos de seguridad deben lidiar con cómo evolucionar sus prácticas de seguridad de datos y gestión de riesgos de terceros para hacer frente a esta tecnología. Deben alcanzar y adelantarse a la adopción ya creciente para no tener que revivir la experiencia de la nube pública compitiendo por delante de la seguridad en la nube.